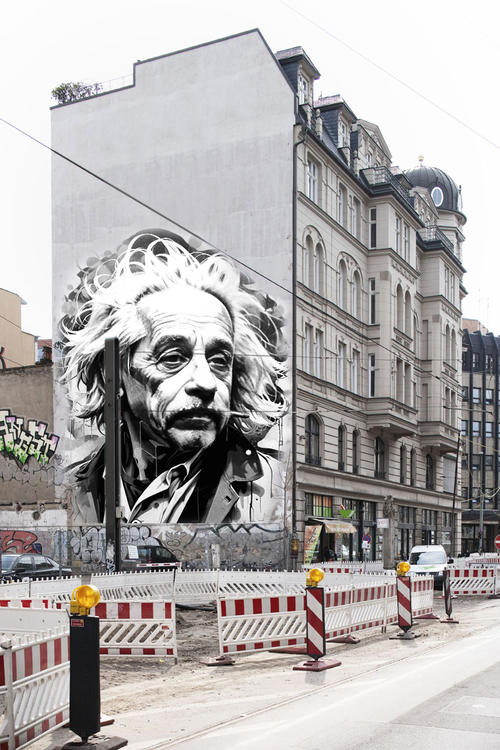

Die zwei Seiten der Medaille

Albert Einstein lebte und arbeitete von 1914 bis 1932 in Berlin, schuf hier mit der Allgemeinen Relativitätstheorie sein bedeutendstes Werk und emigrierte schließlich 1933 in die USA.

Bildquelle: Michael Zalewski, entstanden mit Supermachine (KI)

Mit KI-Tools und den Inhalten, die daraus entstehen, beschäftigt sich auch die Wissenschaftlerin Dr. Dafna Burema. Die Soziologin forscht als Postdoc im Exzellenzcluster Science of Intelligence (SCIoI) an der Technischen Universität Berlin. Ihre Forschungsfragen drehen sich rund um das menschliche Verhalten und die Gesellschaft im Kontext von Technologien: „Ich schaue mir an, wie und warum Menschen künstliche Intelligenz erschaffen und habe vor allem auch einen Blick auf die damit verbundenen ethischen Fragen. Werden ethische Gesichtspunkte beim Kreieren von KI-Tools berücksichtig und richtig angewendet? Sind die neuen Technologien hilfreich oder nicht?“

KI ist schon im Alltag angekommen

Bereits heute nutze nahezu jeder Mensch im Alltag unbewusst KI – in Streamingdiensten, beim Online-Shoppen, über Spamfilter oder beim Navigieren. Inzwischen sei es nahezu unmöglich, keine KI anzuwenden, sagt Dafna Burema. Generative KI geht allerdings einen Schritt weiter: Sie erstellt auf Basis von Trainingsdaten völlig neue Inhalte – Texte, Bilder, Musik oder Videos.

Für die Wissenschaftskommunikation können solche KI-Tools sehr hilfreich sein: Komplexe und umfangreiche wissenschaftliche Publikationen lassen sich etwa durch Textprogramme rasch übersetzen, vereinfachen und kürzen, so dass sie auch für Laien verständlich werden. Bildprogramme kreieren mithilfe der richtigen Prompts Abbildungen von schwer zu beobachtenden Phänomenen oder abstrakten Konzepten. Sie können Daten und Muster veranschaulichen und die unterschiedlichsten Zielgruppen ansprechen. KI kann also dazu beitragen, dass Forschung und ihre Ergebnisse verständlicher und zugänglicher kommuniziert werden.

Doch es gibt auch Risiken wie etwa Manipulationen von Inhalten oder das Vortäuschen von falschen Tatsachen. Der Datenschutz und das Recht am geistigen Eigentum sind weitere Kritikpunkte, die häufig angeführt werden, wenn es um die Nutzung von KI geht. Die Modelle werden meist mit Texten, Bildern, Kunstwerken und Daten trainiert, ohne die Erlaubnis der Urheber*innen und Eigentümer*innen einzuholen. Auch die Frage der Transparenz ist bedeutend: Müssen KI-Inhalte als solche gekennzeichnet werden oder dürfen Nutzer*innen darüber im Unklaren gelassen werden, dass das, was sie lesen oder betrachten, nicht von einem Menschen geschaffen wurde? Und schließlich sind KI-Inhalte nicht unfehlbar. Der Begriff „KI-Bias“ beschreibt, wie menschliche Vorurteile KI-Algorithmen beeinflussen und zu verzerrten Ergebnissen führen, die dann beispielsweise bestimmte soziale Gruppen benachteiligen können.

Transparenz ist wichtig

„In dem Forschungsfeld KI und Ethik geht es darum, all diese Unsicherheiten und Grauzonen genauer zu betrachten und Leitlinien und Regeln für das Nutzen von KI zu entwickeln“, beschreibt Dafna Burema eine ihrer Forschungsaufgaben, die sich an der Schnittstelle von Soziologie und Technologie bewegt. „Und auch um die Frage, ob und warum wir KI überhaupt wollen und brauchen.“

Dafna Burema hält Transparenz für eines der wichtigsten Kriterien im Umgang mit KI. „Viele Probleme und Risiken resultieren daraus, dass die Menschen nicht wissen, dass sie mit einer künstlichen Intelligenz interagieren oder Inhalte konsumieren, die mit KI erzeugt wurden.“ Bots - also automatisierte Softwareprogramme -, Deep Fakes und Fake News sind die Negativbeispiele, die mithilfe von KI in enormen Mengen auf Knopfdruck erzeugt werden können und sich vor allem in den Sozialen Medien rasant verbreiten. Andererseits sei KI in der Lage, Inhalte für sehr viele Menschen erst zugänglich zu machen und Wissenschaftler*innen dabei zu unterstützen, ihre Ergebnisse und Botschaften an eine breite Bevölkerung zu kommunizieren, ist Dafna Burema überzeugt. „KI kann auch demokratisierend wirken“, betont die Forscherin. „Etwa, wenn Sprachbarrieren mithilfe von Chat- oder Übersetzungsprogrammen überwunden werden.“ Letztendlich sei KI – wie viele technologische Errungenschaften – ein Instrument, dass Risiken in sich berge, gleichzeitig aber viel Gutes bewirken könne. „Es hat zwei Seiten und wir müssen sorgsam und auch kritisch damit umgehen“, fasst die Forscherin zusammen. „Dabei sollten wir nicht zu pessimistisch sein, denn die Vorteile von KI sind in vielen Bereichen enorm.“